AI Visibility checker : checkez votre score d'accessibilité pour les LLMs

Vérifiez que votre fichier robots.txt ne bloque pas l'accès à votre site aux principaux LLMs. Cela permet aux LLMs de pouvoir visiter votre pages, les lire pour enrichir la réponse donnée à un utilisateur.

100%

Score d'Accessibilité IA

Parfait !

Permission des Bots IA / LLMs

ChatGPT

Refusé

Perplexity

Refusé

Claude / Anthropic

Refusé

Gemini / Google

Refusé

Amazon

Refusé

Meta AI

Refusé

Mistral

Refusé

Apple

Refusé

Huawei

Refusé

Extraction de robots.txt

Nous analysons votre fichier robots.txt pour récupérer les règles qui sont définies.

Comparaison avec les LLMs

Le fichier robots.txt est checké pour voir si les LLMs sont autorisés à visiter vos pages (et donc connaître votre contenu).

Score de Visibilité

On vous donne un score de visibilité avec des pistes d'amélioration. Le tout en moins de 2 secondes.

Questions fréquentes sur le fichier robots.txt et la visibilité sur les LLMs

Comment faites-vous pour analyser la visibilité ?

Cet outil checke uniquement le fichier robots.txt de votre site. Concrètement, on visite la page /robots.txt de votre site, on extrait le contenu et on regarde les règles définies. Si à l'intérieur, on voit des bots de LLMs qui ne sont pas autorisés, on va changer le score donné.

Comment bots regardez-vous exactement ?

Notre outil vérifie la visibilité de votre site auprès des 9 principaux moteurs de recherche IA :

Pourquoi tous les crawlers ne sont pas listés ?

2 choses sont importantes ici :

1. Nous nous focalisons sur les principaux LLMs

2. Nous analysons uniquement les bots de recherche IA, pas les bots d'entraînement. Ces bots permettent aux assistants IA de citer et afficher votre contenu lorsqu'un utilisateur pose une question. Si vous les bloquez, votre site sera invisible dans les réponses de ChatGPT, Perplexity, Claude et autres.

Si j'ai un score inférieur à 80, que cela signifie t-il ?

Cela veut dire qu'une partie des bots des LLMS et/ou de vos pages ne sont pas autorisés à parcourir votre site ou certaines pages. Si c'est volontaire et que cela découle d'une stratégie, aucun problème. En revanche, si vous voulez que tous les LLMs viennent sur votre site, vous feriez mieux de retravailler votre robots.txt

À quoi sert un fichier robots.txt ?

Ce fichier indique aux crawlers quelles zones de votre site ils peuvent explorer. Il ne protège pas vos données, mais dicte des règles d’indexation aux bots qui choisissent de les respecter.

Puis-je bloquer entièrement les IA ?

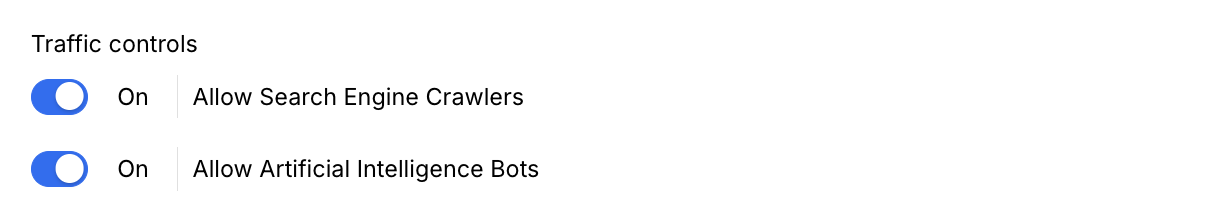

Oui, en désactivant directement dans Webflow en décochant "Allow Artificial Intelligence Bots" au niveau des settings SEO.

Vous pouvez ausis le faire manuellement dans le fichier robots.txt (voir notre outil dédié)

Toutefois, cela peut réduire votre visibilité dans :

- les réponses générées par ChatGPT / Claude

- les citations Perplexity

- les moteurs IA émergents

C’est un choix stratégique qu'il faut mesurer en amont.

Comment optimiser l’accès des LLM pour maximiser ma visibilité ?

Pour augmenter la probabilité d’être cité par les IA :

- Autoriser GPTBot, ClaudeBot, Perplexity

- Ne pas restreindre les pages publiques

- Avoir un contenu structuré (Hn, Schema.org, JSON-LD)

- Ajouter un fichier llms.txt

- Produire des pages explicites, pédagogiques et bien formatées

Justa propose une librairie AI Share pour améliorer ça également

Quelle est la différence entre robots.txt et llms.txt ?

Le fichier robots.txt est le standard historique pour les moteurs de recherche classiques alors que le fichier llms.txt est un format expérimental destiné aux modèles IA. Vous pouvez générer un fichier LLMs.txt sur notre outil.

Puis-je bloquer uniquement certaines pages pour les IA ?

Oui. Nous avons créé un générateur pour choisir précisément les bots autorisés et sur quelles pages. Par exemple, on pourrait faire la chose suivante ;

- autoriser Perplexity

- bloquer Chat GPT

- autoriser ClaudeBot

- Mais ne pas autoriser le crawl des pages commençant par /outils

.svg)